文章详情页

python - scrapy运行爬虫一打开就关闭了没有爬取到数据是什么原因

浏览:146日期:2022-08-05 15:09:38

问题描述

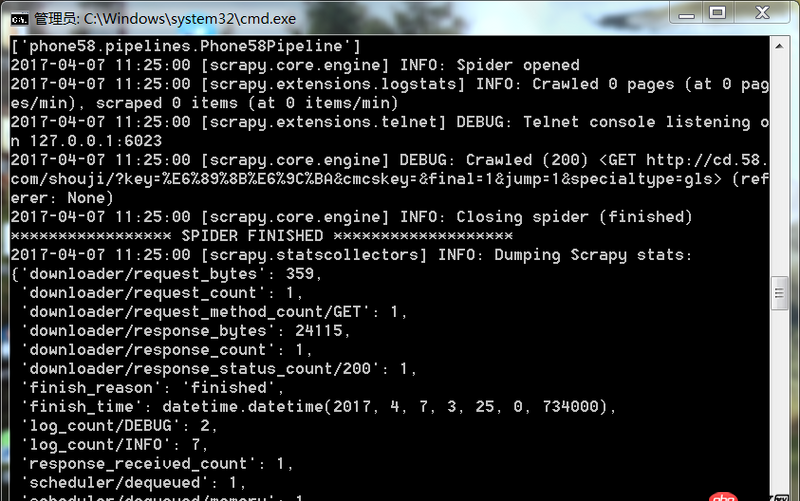

爬虫运行遇到如此问题要怎么解决

问题解答

回答1:很可能是你的爬取规则出错,也就是说你的spider代码里面的xpath(或者其他解析工具)的规则错误。导致没爬取到。你可以把网址print出来,看看是不是[]

相关文章:

1. python - flask jinjia2 中怎么定义嵌套变量2. java - JPA连接数据库,一段时间没有数据操作会关闭连接,再次访问就会抛出异常,如何解决?3. python开发的脚本想上个ui,用哪个库来绘制窗口比较好?求推荐4. Mysql取下一条记录5. javascript - Chrome 扩展,更新别人的扩展 能不能上传到插件商店?6. 清除nginx的文件缓存7. html - css 文件内,有的样式没调用, 有没有工具删除这部分没调用的内容?8. mysql federated引擎无法开启9. Chrome-org.openqa.selenium.WebDriverException:未知错误:无法在driver.manage()window()maximize();处获得自动化扩展10. javascript 如何下载一个excel文件 ?

排行榜

网公网安备

网公网安备