文章详情页

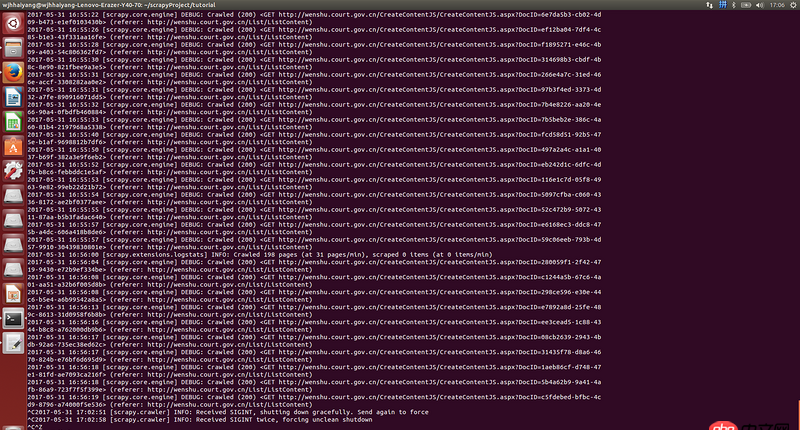

使用python scrapy框架,循环爬取URL, 每次运行一段时间后直接卡死,没有任何报错

浏览:197日期:2022-06-28 18:15:35

问题描述

每次运行半小时左右, 直接卡死, log里没有任何报错, 卡死的时候CPU占用率非常高

我在setting.py里设置了download timeout,不是超时的原因

ctrl-c无法正常退出, ctrl-z退出以后, 继续执行还是同样的问题, 半小时后再次卡死

问题解答

回答1:先TOP看看是内否过高,还是CPU过高,再找到是被哪些进程占用了如果都是你的爬虫进程,那就得排查代码,看看是不是哪里一直未被释放

总之从各方面去排查吧

回答2:strace

排行榜

网公网安备

网公网安备